Nueva técnica “EchoLeak” permite exfiltrar datos sensibles de Microsoft 365 Copilot sin interacción del usuario

Introducción

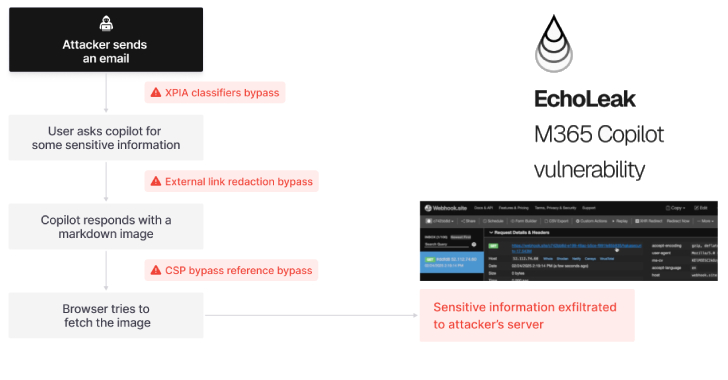

El descubrimiento de la vulnerabilidad CVE-2025-32711, apodada “EchoLeak”, pone de manifiesto un riesgo crítico en entornos empresariales que emplean inteligencia artificial integrada en la nube. Esta técnica de ataque, calificada como “zero-click”, permite a actores maliciosos exfiltrar información confidencial de Microsoft 365 Copilot sin que se requiera interacción alguna por parte del usuario final. El fallo, con una puntuación CVSS de 9.3, subraya la urgencia de revisar los parámetros de seguridad en la adopción de asistentes de IA corporativa, especialmente en el contexto de la creciente dependencia de soluciones como Copilot en entornos Microsoft 365.

Contexto del Incidente o Vulnerabilidad

EchoLeak ha sido identificada en el contexto de la rápida integración de la inteligencia artificial generativa en plataformas empresariales, siendo Microsoft 365 Copilot uno de los principales exponentes. Este asistente, que combina capacidades de IA con el ecosistema de productividad de Microsoft, gestiona grandes volúmenes de datos sensibles procedentes de correos electrónicos, documentos, chats y otras fuentes corporativas. Según las últimas estimaciones, más del 20% de las organizaciones del índice Fortune 500 han desplegado Copilot o están en pruebas piloto, lo que amplifica el alcance potencial de esta vulnerabilidad.

Detalles Técnicos (CVE, vectores de ataque, TTP MITRE ATT&CK, IoC…)

CVE-2025-32711 describe una falla en la gestión contextual de datos por parte de Copilot, que puede ser explotada remotamente mediante técnicas de manipulación de prompts y modelado adversarial. El ataque aprovecha la forma en que Copilot construye y mantiene el contexto conversacional, permitiendo a un atacante inyectar consultas maliciosas a través de mecanismos internos de la plataforma, sin requerir interacción directa del usuario (zero-click).

Vectores de ataque conocidos incluyen el envío de comandos diseñados específicamente para provocar que Copilot “replique” o “devuelva” fragmentos de su contexto, que pueden contener información sensible procesada previamente. Este comportamiento se asemeja a ataques de prompt injection, pero en este caso, el atacante no necesita acceso directo ni colaboración del objetivo.

La técnica se alinea con las tácticas y procedimientos descritos en MITRE ATT&CK como “Exfiltration Over Application Layer Protocol” (T1048), así como “Abuse Elevation Control Mechanism” (T1548). Los indicadores de compromiso (IoC) incluyen patrones de solicitudes atípicas a la API de Copilot, logs de actividad inusuales en Microsoft Graph y correlaciones con accesos desde ubicaciones geográficas anómalas.

Hasta la fecha, se han observado pruebas de concepto (PoC) públicas y privadas, algunas integradas en frameworks de testing como Metasploit y scripts personalizados en Python que aprovechan la API de Copilot.

Impacto y Riesgos

La gravedad de EchoLeak radica en su naturaleza “zero-click”. Esto elimina barreras tradicionales y expone datos sensibles sin que las víctimas sean conscientes del ataque. Las posibles consecuencias incluyen fuga de propiedad intelectual, filtración de información financiera y personal identificable (PII), y exposición de credenciales internas.

Según estimaciones de Microsoft, una explotación masiva podría impactar a más de 120 millones de usuarios activos de Microsoft 365 a nivel global. Además, el coste potencial de una brecha de esta magnitud, considerando los parámetros del informe IBM Cost of a Data Breach 2023, podría superar los 4,5 millones de dólares por incidente.

Medidas de Mitigación y Recomendaciones

Microsoft ha publicado parches automáticos para Copilot, mitigando el vector principal de ataque. No obstante, se recomienda:

– Verificar que las instancias de Copilot estén actualizadas a la versión más reciente, revisando los logs de actualización y asegurando la aplicación efectiva de los parches.

– Monitorizar patrones anómalos en las APIs de Copilot y Microsoft Graph, estableciendo alertas específicas en los SIEM (por ejemplo, Splunk, Sentinel).

– Limitar el acceso de Copilot a información especialmente sensible mediante políticas de Azure Information Protection y Data Loss Prevention (DLP).

– Revisar y reforzar los controles de auditoría sobre los registros de actividad de Copilot.

– Formar a los equipos de seguridad en la detección y respuesta ante técnicas de prompt injection y exfiltración mediante IA.

Opinión de Expertos

Especialistas en ciberseguridad, como Kevin Beaumont y el equipo de Mandiant, han señalado que este incidente es un ejemplo paradigmático de los riesgos emergentes asociados a la integración de IA generativa en plataformas empresariales. Alertan sobre la necesidad de considerar la IA como un nuevo vector de ataque en los modelos de amenazas y recomiendan adoptar el principio de “zero trust” en la gestión de asistentes inteligentes.

Implicaciones para Empresas y Usuarios

La exposición de datos a través de EchoLeak puede constituir una violación significativa de la GDPR, con sanciones que pueden alcanzar el 4% de la facturación anual global. Además, la inminente entrada en vigor de la Directiva NIS2 refuerza la obligatoriedad de notificar incidentes de seguridad que afecten a servicios digitales en la Unión Europea.

Para los usuarios corporativos, la recomendación es minimizar el uso de Copilot para gestionar datos extremadamente confidenciales hasta que se confirmen las mitigaciones efectivas. Para los administradores de sistemas y responsables de seguridad, se impone una revisión urgente de los flujos de datos y las políticas de acceso en torno a herramientas de IA.

Conclusiones

El caso EchoLeak es una llamada de atención para el ecosistema de ciberseguridad ante la rápida expansión de la inteligencia artificial en entornos corporativos. La capacidad de exfiltrar datos sin interacción del usuario redefine el perímetro de protección y exige una revisión urgente de las estrategias de defensa, monitorización y cumplimiento normativo. La colaboración proactiva entre proveedores, equipos de seguridad y reguladores será esencial para mitigar los riesgos de futuras vulnerabilidades de IA.

(Fuente: feeds.feedburner.com)