**Alerta por imágenes satelitales generadas por IA: un riesgo emergente para la seguridad nacional**

—

### Introducción

La proliferación de tecnologías de inteligencia artificial (IA) ha traído consigo avances significativos en el procesamiento y análisis de imágenes satelitales. Sin embargo, esta misma capacidad está dando lugar a nuevos vectores de ataque y amenazas emergentes que, hasta ahora, han pasado en gran medida inadvertidos para la mayoría de los actores en ciberseguridad. Recientemente, un estudiante de secundaria ha puesto de manifiesto el potencial riesgo de la manipulación de imágenes satelitales mediante IA, un problema que podría afectar gravemente la toma de decisiones críticas en ámbitos gubernamentales y de respuesta a emergencias.

—

### Contexto del Incidente o Vulnerabilidad

El incidente parte de una investigación independiente realizada por un estudiante de secundaria, quien demostró la facilidad con la que los modelos generativos de IA pueden crear o alterar imágenes satelitales de alta resolución. Esta práctica, poco analizada hasta ahora en foros profesionales, plantea un reto significativo: la posibilidad de que estados, grupos criminales o incluso actores individuales generen imágenes falsas para engañar a gobiernos, fuerzas armadas o equipos de emergencia.

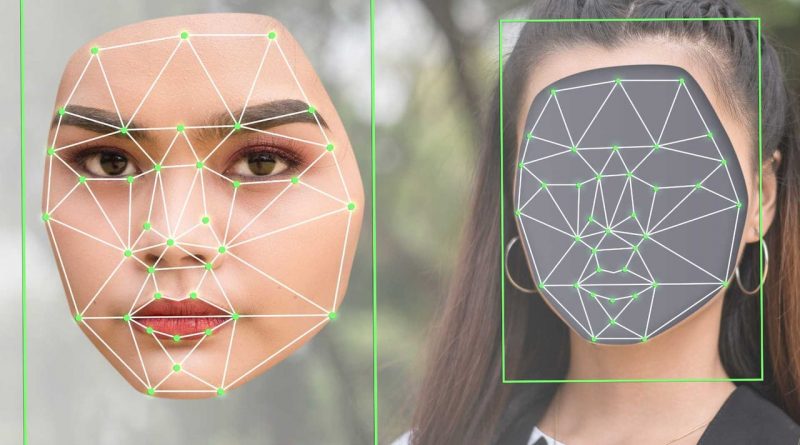

La manipulación de imágenes satelitales no es nueva; históricamente se ha recurrido a técnicas de edición manual. Sin embargo, el uso de IA, especialmente de redes generativas adversarias (GAN), incrementa la escala y la credibilidad de estas falsificaciones, permitiendo la creación masiva y automatizada de imágenes sintéticas con un realismo difícil de detectar incluso por analistas experimentados.

—

### Detalles Técnicos

Las imágenes satelitales generadas o alteradas mediante IA emplean principalmente GANs, frameworks como TensorFlow o PyTorch y, en algunos casos, herramientas de código abierto como Stable Diffusion o DALL-E para tareas específicas. El proceso de generación implica entrenar a la IA con miles de imágenes reales para que aprenda patrones de terreno, estructuras urbanas y otros elementos característicos.

Las técnicas de ataque pueden clasificarse bajo los siguientes vectores:

– **Spear Phishing Visual**: Se envían imágenes manipuladas a destinatarios específicos, como responsables gubernamentales o analistas de emergencias, para inducir a confusión o señalar amenazas inexistentes.

– **Supply Chain Attack**: Alteración de imágenes en servicios de teledetección o plataformas de análisis geoespacial utilizados por terceros.

– **Data Poisoning**: Inyección de imágenes sintéticas en datasets de entrenamiento de sistemas automáticos de análisis geoespacial, comprometiendo la fiabilidad de los sistemas automáticos de alerta y respuesta.

Según la taxonomía MITRE ATT&CK, estos ataques se alinean con las técnicas T1566 (Phishing), T1565 (Data Manipulation) y T1195 (Supply Chain Compromise). Los indicadores de compromiso (IoC) incluyen anomalías en los metadatos de las imágenes, inconsistencias en las fuentes de luz y sombras, y patrones de pixelado sospechosos.

No se han registrado CVEs específicos asociados aún, pero se prevé que herramientas de validación de imágenes y sistemas de almacenamiento de datos geoespaciales sean los primeros objetivos de futuras vulnerabilidades explotables.

—

### Impacto y Riesgos

El impacto potencial de imágenes satelitales falsificadas por IA es considerable. Un informe reciente de la consultora Gartner estima que para 2026, más del 30% de los incidentes de inteligencia geoespacial podrían estar relacionados con manipulación de datos mediante IA. Entre los riesgos destacan:

– **Desinformación en escenarios de crisis**: Imágenes alteradas podrían inducir evacuaciones innecesarias, desviar recursos de emergencia o incluso provocar incidentes diplomáticos.

– **Sabotaje estratégico**: Estados hostiles podrían fabricar pruebas visuales de movilización militar o desastres naturales inexistentes para influir en la opinión pública o provocar respuestas desproporcionadas.

– **Fraude económico**: Empresas aseguradoras y de logística pueden ser engañadas para reclamar indemnizaciones fraudulentas o modificar rutas comerciales críticas.

La exposición a estos riesgos afecta tanto a organismos públicos como a empresas privadas, especialmente aquellas sujetas a regulaciones internacionales como el GDPR o la Directiva NIS2, que exigen la integridad y disponibilidad de los datos procesados.

—

### Medidas de Mitigación y Recomendaciones

Para mitigar estos riesgos, se recomienda a los profesionales del sector implementar controles estrictos de verificación de autenticidad en el pipeline de procesamiento de imágenes satelitales:

1. **Sistemas de validación forense**: Utilizar herramientas de análisis forense digital especializadas en imágenes (por ejemplo, FotoForensics o JPEGSnoop) para detectar inconsistencias y manipulación.

2. **Cross-checking multisource**: Correlacionar imágenes satelitales con datos de diferentes proveedores y sensores (infrarrojo, radar, óptico) para descartar falsificaciones.

3. **Auditoría de datasets de entrenamiento**: Revisar y limpiar periódicamente los conjuntos de datos utilizados en sistemas de IA para evitar la contaminación por data poisoning.

4. **Implementación de firmas digitales y blockchain**: Proteger la cadena de custodia de las imágenes mediante firmas criptográficas y registros inmutables en blockchain.

5. **Capacitación y concienciación**: Formación específica para analistas y personal técnico sobre técnicas emergentes de manipulación de imágenes por IA.

—

### Opinión de Expertos

Especialistas en ciberinteligencia, como los miembros del European Union Agency for Cybersecurity (ENISA), advierten que «la capacidad de generar deepfakes geoespaciales a escala industrial representa un desafío sin precedentes para la confianza en la infraestructura digital.» Según el Dr. Pablo Ruiz, analista de amenazas en S21sec, “la detección de imágenes sintéticas es ya una prioridad para los equipos de threat hunting, especialmente en ámbitos críticos como defensa nacional y gestión de infraestructuras.”

—

### Implicaciones para Empresas y Usuarios

El fenómeno de la manipulación de imágenes satelitales por IA obliga a revisar los protocolos internos de gestión de información visual en sectores como energía, transporte y seguros. Para las empresas, supone un reto adicional para el cumplimiento normativo bajo GDPR y NIS2, ya que la integridad de los datos debe ser demostrable en todo momento. Los usuarios finales, como responsables de emergencias o administradores de sistemas, deben extremar la cautela ante cualquier anomalía detectada en los flujos de datos geoespaciales.

—

### Conclusiones

La aparición de imágenes satelitales falsas generadas por IA marca un punto de inflexión en la seguridad de la información geoespacial. Aunque la amenaza ha sido visibilizada por un estudiante, su impacto potencial es global, transversal y de alta criticidad. La anticipación, formación y el desarrollo de mecanismos avanzados de validación serán claves para mitigar este nuevo vector de ataque, en un contexto donde la confianza en la imagen digital no puede darse por sentada.

(Fuente: www.darkreading.com)