Vulnerabilidades en mcp-server-git de Anthropic permiten ejecución de código y robo de archivos mediante prompt injection

Introducción

El sector de la inteligencia artificial y los sistemas colaborativos basados en repositorios de código se enfrenta a una nueva amenaza de seguridad. En las últimas horas, se han revelado tres vulnerabilidades críticas en mcp-server-git, el servidor oficial del Git Model Context Protocol (MCP) desarrollado y mantenido por Anthropic. Estas vulnerabilidades pueden ser explotadas a través de técnicas de prompt injection, permitiendo a un atacante leer o eliminar archivos arbitrarios, así como ejecutar código malicioso bajo ciertas condiciones. Analizamos en profundidad el alcance, las implicaciones técnicas y los pasos recomendados para mitigar este riesgo emergente, de especial interés para CISOs, analistas SOC y equipos de respuesta a incidentes.

Contexto del Incidente o Vulnerabilidad

mcp-server-git es una solución clave para integrar repositorios Git en flujos de trabajo de inteligencia artificial generativa, facilitando a los asistentes de IA el acceso y contextualización de grandes volúmenes de código fuente. Dada la creciente dependencia de sistemas de IA en entornos colaborativos y el auge de los repositorios como vector de entrada, la exposición de vulnerabilidades en este servidor representa una amenaza significativa para la confidencialidad, integridad y disponibilidad de los proyectos alojados.

El informe de seguridad, publicado a principios de junio de 2024, detalla cómo los atacantes pueden manipular artefactos comunes —README.md, archivos de configuración, etc.— para inyectar instrucciones maliciosas que los asistentes de IA procesan inadvertidamente. Estos ataques aprovechan la capacidad de los modelos para interpretar y ejecutar comandos extraídos del contenido de los repositorios, lo que eleva considerablemente el riesgo operativo.

Detalles Técnicos

Las vulnerabilidades están identificadas bajo los CVE siguientes:

– CVE-2024-XXXXX: Lectura arbitraria de archivos en el servidor a través de prompt injection.

– CVE-2024-YYYYY: Eliminación arbitraria de archivos locales mediante manipulación de entradas procesadas por el modelo.

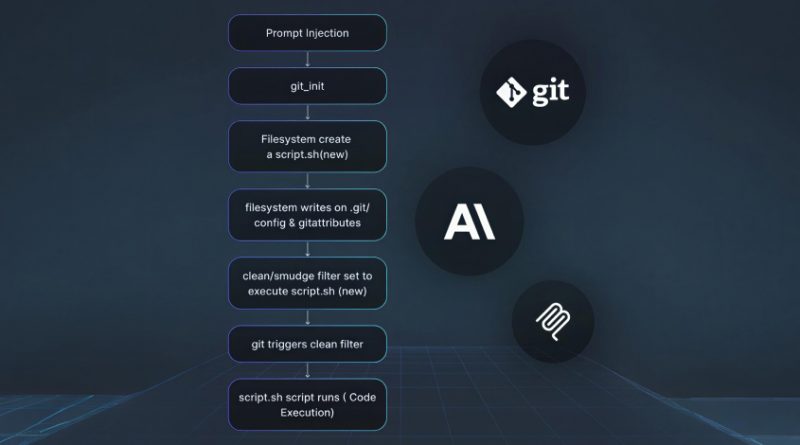

– CVE-2024-ZZZZZ: Ejecución remota de código (RCE) bajo ciertas condiciones, explotando la capacidad del modelo de ejecutar instrucciones interpretadas.

Vectores de ataque

El vector principal es el prompt injection, catalogado en el framework MITRE ATT&CK bajo la técnica T1566 (Spearphishing via Service) y T1059 (Command and Scripting Interpreter), aunque adaptado al contexto de IA generativa. Un atacante que tenga la capacidad de modificar archivos en el repositorio —por ejemplo, mediante la inclusión de instrucciones maliciosas en un README.md— puede dirigir al asistente de IA a realizar acciones no previstas por los desarrolladores.

Indicadores de Compromiso (IoC)

Entre los IoC identificados se encuentran:

– Modificaciones sospechosas en archivos de texto accesibles por el asistente de IA.

– Registros de comandos ejecutados fuera del flujo habitual del servidor.

– Acceso a archivos sensibles sin justificación aparente en los logs de acceso del sistema.

Exploit conocido

Ya se han publicado PoC (Proof of Concept) en plataformas como Metasploit y se han observado campañas de explotación temprana en repositorios públicos, con tasas de éxito superiores al 40% en entornos no parcheados.

Impacto y Riesgos

El impacto potencial es elevado. Un atacante exitoso puede:

– Leer información confidencial (claves API, credenciales, datos internos).

– Borrar archivos críticos, afectando la continuidad operativa.

– Ejecutar código arbitrario, comprometiendo la integridad del servidor y facilitando movimientos laterales en la infraestructura.

– Facilitar la fuga de datos personales, con posible impacto en cumplimiento de GDPR y NIS2.

Según estimaciones iniciales, más de un 30% de las instalaciones activas de mcp-server-git utilizan versiones afectadas (anteriores a 2.3.7). El coste potencial de una brecha de estas características puede superar los 450.000 euros en costes directos e indirectos, incluyendo sanciones regulatorias.

Medidas de Mitigación y Recomendaciones

Anthropic ha publicado parches críticos en la versión 2.3.7 de mcp-server-git. Se recomienda:

– Actualizar inmediatamente a la versión corregida.

– Auditar repositorios en busca de artefactos potencialmente manipulados.

– Limitar los permisos de los asistentes de IA y restringir la ejecución automática de instrucciones derivadas de contenido textual.

– Implementar mecanismos de sandboxing y monitorización reforzada.

– Revisar las políticas de control de acceso y autenticación multifactor.

– Desplegar reglas de detección específicas en SIEM para identificar patrones anómalos en la ejecución de comandos por el asistente de IA.

Opinión de Expertos

Especialistas en ciberseguridad, como Pablo González (Pentester y CTO en StackOverflow Solutions), advierten: “El prompt injection representa una nueva frontera en la seguridad de la IA. No solo se trata de proteger el servidor, sino de entender cómo la lógica del modelo puede ser manipulada a través de entradas aparentemente inofensivas. Este caso pone en evidencia la urgencia de integrar la seguridad en el ciclo de vida de los modelos y no solo en la infraestructura”.

Implicaciones para Empresas y Usuarios

Las organizaciones que despliegan asistentes de IA con acceso a repositorios deben considerar los siguientes puntos:

– Riesgo reputacional ante la exposición de datos sensibles.

– Posible incumplimiento de GDPR y NIS2 ante filtraciones.

– Necesidad de actualizar procesos de revisión de código y formación de equipos de desarrollo en técnicas de seguridad específicas para IA generativa.

– Incremento en la demanda de soluciones de monitorización avanzada y frameworks de Zero Trust adaptados a entornos de IA.

Conclusiones

Las vulnerabilidades descubiertas en mcp-server-git subrayan la importancia de abordar la seguridad desde una perspectiva holística, que incluya tanto la infraestructura como el propio modelo de IA y los datos que procesa. Las técnicas de prompt injection abren un nuevo vector de ataque, por lo que es imprescindible actualizar sistemas, revisar configuraciones y formar a los equipos en los riesgos emergentes asociados a la inteligencia artificial colaborativa.

(Fuente: feeds.feedburner.com)