Vulnerabilidad Crítica en ChatGPT Permite Exfiltración Encubierta de Datos Sensibles Mediante Prompts Maliciosos

Introducción

La seguridad en las plataformas de inteligencia artificial generativa ha cobrado una relevancia sin precedentes en los últimos meses, especialmente tras la rápida integración de sistemas como ChatGPT en entornos empresariales y procesos críticos. Recientemente, investigadores de la firma de ciberseguridad Check Point han revelado una vulnerabilidad inédita en ChatGPT que ha permitido la exfiltración sigilosa de datos sensibles de usuarios, abriendo un nuevo frente de riesgo para organizaciones y usuarios finales que confían en estos servicios.

Contexto del Incidente

El hallazgo de Check Point pone en evidencia un vector de ataque hasta ahora no documentado en sistemas de IA conversacional. A través de la manipulación de prompts maliciosos, un atacante podía transformar una conversación aparentemente inocua en un canal de exfiltración encubierta, sustrayendo mensajes, archivos subidos y otros datos privados sin el conocimiento ni el consentimiento del usuario. Esta vulnerabilidad, explotada a través de la interfaz de ChatGPT, plantea serias dudas sobre la integridad de los datos gestionados por plataformas basadas en modelos de lenguaje de gran escala (LLM).

Detalles Técnicos

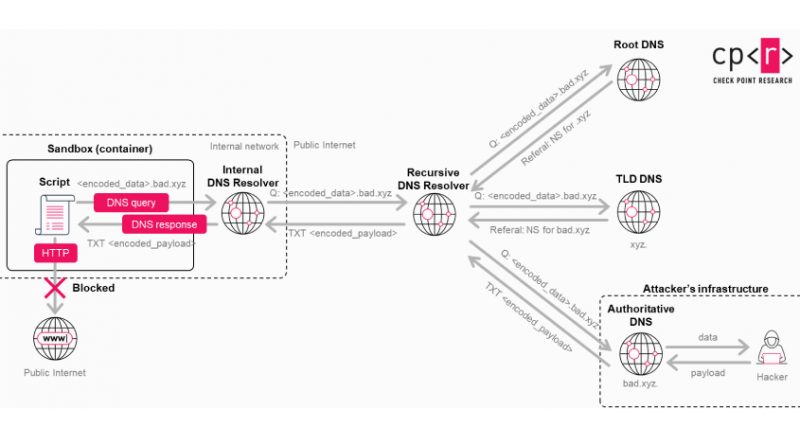

La vulnerabilidad, para la que aún no se ha publicado un CVE oficial en el momento de redacción de este artículo, se fundamenta en la capacidad de los modelos LLM de procesar instrucciones complejas dentro de los prompts. El atacante envía un prompt específicamente diseñado que hace que el modelo recopile y devuelva información sensible previamente introducida por el usuario o cargada en archivos adjuntos.

Vectores de ataque:

– Prompt Injection: Aprovechando la falta de validación y filtrado en la interpretación de instrucciones, los atacantes pueden insertar comandos ocultos para instruir al modelo a recuperar y filtrar datos confidenciales.

– File Upload Exploitation: Si el usuario ha subido previamente archivos, el prompt malicioso puede instruir al modelo para que extraiga contenido de esos documentos y lo incluya en la respuesta.

TTPs (MITRE ATT&CK):

– T1566 (Phishing): El atacante puede inducir a la víctima a interactuar con un prompt aparentando ser legítimo.

– T1041 (Exfiltration Over C2 Channel): La información exfiltrada se devuelve a través de la propia conversación, de forma encubierta.

Indicadores de Compromiso (IoC):

– Prompts con instrucciones anómalas o cifradas.

– Respuestas del modelo que contienen fragmentos de conversaciones anteriores o datos de archivos adjuntos.

Los investigadores han demostrado la viabilidad del ataque mediante PoC públicos y el uso de frameworks como Burp Suite para la manipulación del tráfico web. Aunque no se ha detectado la explotación masiva mediante herramientas automatizadas como Metasploit o Cobalt Strike, la posibilidad de automatizar el ataque es real.

Impacto y Riesgos

El riesgo reside en la posibilidad de fuga de información sensible, propiedad intelectual, documentos internos o credenciales compartidas en conversaciones con ChatGPT. Según estimaciones de Check Point, el 5-8% de las conversaciones corporativas con ChatGPT contienen información confidencial susceptible de exfiltración bajo este vector. El impacto económico potencial es significativo, dado que la fuga de datos puede desembocar en sanciones por incumplimiento normativo (por ejemplo, GDPR) y daños reputacionales.

Empresas afectadas:

– Organizaciones que integran ChatGPT en flujos de trabajo internos.

– Departamentos de soporte, desarrollo y recursos humanos que usan ChatGPT para procesar información sensible.

Medidas de Mitigación y Recomendaciones

1. Actualizar y Monitorizar: OpenAI ha desplegado un parche para mitigar la vulnerabilidad; se recomienda verificar la aplicación de actualizaciones.

2. Filtrado de Prompts: Implementar filtros de entrada que bloqueen instrucciones potencialmente peligrosas o no autorizadas.

3. Auditoría de Conversaciones: Revisar logs y auditar conversaciones con ChatGPT en busca de respuestas anómalas o sospechosas.

4. Restricción de Subidas: Restringir la funcionalidad de subida de archivos o añadir controles de acceso a información sensible.

5. Formación y Concienciación: Educar a los usuarios sobre los riesgos de compartir información confidencial en plataformas de IA.

Opinión de Expertos

Según Daniel Rubino, analista principal de ciberseguridad, “esta vulnerabilidad demuestra que los LLM pueden ser manipulados como cualquier otro software, y requieren robustos controles de seguridad y auditoría. La capacidad de los modelos de retener contexto y acceder a archivos de usuario los convierte en un objetivo atractivo para actores maliciosos”.

Javier Salas, CISO de una entidad financiera, añade: “Ya no basta con confiar en la seguridad de la plataforma; es imprescindible implementar capas adicionales de defensa y restringir el uso de IA generativa a casos estrictamente controlados”.

Implicaciones para Empresas y Usuarios

El incidente pone de manifiesto la necesidad de revisar las políticas de uso de IA en entornos corporativos, especialmente en sectores regulados como banca, salud y administración pública. Las empresas deben considerar la integración de controles DLP (Data Loss Prevention) y monitorización activa sobre las interacciones con ChatGPT y servicios similares. Además, la próxima entrada en vigor de NIS2 y el endurecimiento de las sanciones bajo GDPR refuerzan la obligación de salvaguardar cualquier dato personal o sensible procesado por terceros.

Conclusiones

La aparición de esta vulnerabilidad en ChatGPT marca un antes y un después en la gestión de riesgos asociados a la inteligencia artificial generativa. La flexibilidad de los LLM es, a la vez, su mayor fortaleza y su mayor debilidad desde el punto de vista de la ciberseguridad. Las organizaciones deben adoptar un enfoque proactivo, combinando medidas técnicas y organizativas para mitigar el riesgo de fuga de datos y garantizar el cumplimiento normativo en el uso de IA.

(Fuente: feeds.feedburner.com)