### El auge de los agentes de IA en bug bounty: ¿amenaza u oportunidad para los pentesters humanos?

#### Introducción

La irrupción de la inteligencia artificial (IA) está transformando radicalmente el panorama de la ciberseguridad, y uno de los sectores donde su impacto se está sintiendo con mayor intensidad es en los programas de bug bounty y las firmas de pentesting. En los últimos meses, los agentes automatizados impulsados por IA han comenzado a encontrar y reportar vulnerabilidades antes reservadas a cazadores humanos, generando inquietud y debate entre profesionales del sector. Este fenómeno plantea preguntas cruciales sobre la eficiencia, la ética y el futuro del trabajo en ciberseguridad.

#### Contexto del Incidente o Vulnerabilidad

Los programas de recompensas por errores (bug bounty) han sido, desde hace más de una década, un pilar fundamental en la detección temprana de vulnerabilidades en aplicaciones web, infraestructura cloud y sistemas críticos. Plataformas como HackerOne, Bugcrowd y Synack han permitido a miles de investigadores independientes y empresas de pentesting colaborar con organizaciones para descubrir y mitigar fallos de seguridad a cambio de compensaciones económicas.

Sin embargo, el reciente uso de agentes automatizados y sistemas de IA generativa como GPT-4, Google Gemini y asistentes específicos entrenados para pruebas de seguridad, está alterando este equilibrio. Estas tecnologías son capaces de analizar grandes volúmenes de código, identificar patrones de vulnerabilidad y generar informes automáticos a velocidades inalcanzables para los humanos.

#### Detalles Técnicos

El uso de IA en bug bounty y pentesting se articula en dos grandes vertientes: agentes autónomos que realizan escaneos automatizados y sistemas de apoyo al pentester humano (copilotos). Los primeros emplean técnicas de fuzzing inteligente, análisis estático y dinámico de código, y machine learning para identificar vulnerabilidades comunes como Cross-Site Scripting (XSS), Inyección SQL (SQLi), fallos de autenticación (CWE-287) o exposición de datos sensibles (CWE-200).

Muchos de estos agentes integran frameworks conocidos como Metasploit, Burp Suite o incluso scripts personalizados en Python, reforzados con modelos de lenguaje natural para interpretar respuestas de servidores web y adaptar los vectores de ataque. En cuanto a las TTPs (Tácticas, Técnicas y Procedimientos) alineadas con MITRE ATT&CK, destacan las técnicas T1190 (Exploit Public-Facing Application) y T1040 (Network Sniffing). También se están reportando IoCs en logs de plataformas de bug bounty relacionados con patrones de requests generados por IA.

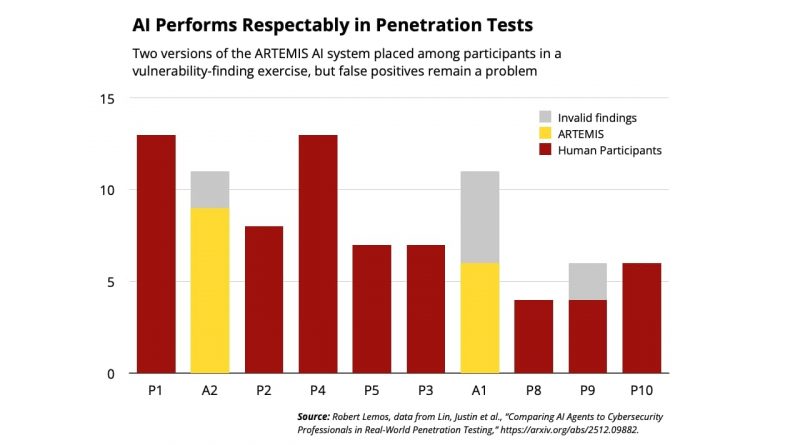

Un caso reciente documentado en una plataforma líder muestra que el 25% de los reportes de vulnerabilidad de bajo nivel (low-hanging fruits) en aplicaciones web—como rutas de administración expuestas o endpoints sin autenticación—fueron generados por agentes de IA en pruebas ciegas (blind tests). Estos sistemas suelen operar sobre versiones específicas de frameworks web (Django <4.2.3, WordPress <6.2.1, etc.), donde las firmas de vulnerabilidades son conocidas y explotables mediante exploits automatizados.

#### Impacto y Riesgos

El principal impacto para el sector es el desplazamiento de los investigadores humanos en la identificación de vulnerabilidades triviales, lo que podría reducir sus ingresos por bug bounty en hasta un 30%, según estimaciones recientes de Bugcrowd. Además, la velocidad y escala a la que operan los agentes de IA puede aumentar la presión sobre los equipos de desarrollo para parchear vulnerabilidades más rápido, pero también incrementar la tasa de falsos positivos y la carga de validación para los equipos internos de seguridad.

Otro riesgo relevante es la posible explotación maliciosa de estos agentes por parte de actores de amenazas, que podrían automatizar la búsqueda y explotación de fallos antes de que sean reportados y corregidos, elevando el riesgo de explotación masiva y filtraciones de datos, con implicaciones directas en el cumplimiento de normativas como el GDPR y la próxima directiva NIS2.

#### Medidas de Mitigación y Recomendaciones

Para mitigar estos riesgos, los expertos recomiendan establecer mecanismos de validación y supervisión humana sobre los reportes generados por agentes de IA. Es crítico ajustar los scopes de los programas de bug bounty para enfocarse en vulnerabilidades de mayor complejidad, donde la intervención humana sigue siendo insustituible.

Las organizaciones deben reforzar sus procesos de triage con herramientas de correlación de alertas y priorización basadas en riesgo real, además de actualizar continuamente sus sistemas de detección y respuesta para identificar patrones de ataques automatizados. Asimismo, es esencial formar a los equipos internos en el uso de IA para pentesting, aprovechando la sinergia humano-máquina.

#### Opinión de Expertos

Según Erik Peterson, CTO de Bugcrowd, “la IA está democratizando la búsqueda de vulnerabilidades, pero la supervisión humana sigue siendo clave para detectar los matices y vulnerabilidades lógicas que las máquinas no comprenden aún”. Por su parte, Marta Beltrán, profesora de Ciberseguridad en la Universidad Rey Juan Carlos, apunta que “la IA no reemplazará al pentester experto, sino que lo potenciará, permitiéndole centrarse en ataques avanzados y análisis de lógica de negocio”.

#### Implicaciones para Empresas y Usuarios

Para las empresas, el auge de la IA en bug bounty representa una oportunidad para reforzar la seguridad de sus activos digitales, pero exige una adaptación de sus procesos de gestión de vulnerabilidades y compliance. En el contexto de la NIS2, la automatización puede ayudar a cumplir los plazos de notificación y corrección, pero también obliga a revisar las políticas de acceso, validación y auditoría.

Para los usuarios, el beneficio potencial es una mayor rapidez en la identificación y mitigación de fallos, aunque persiste el riesgo de que las vulnerabilidades más críticas escapen a los sistemas automatizados si no existe una supervisión adecuada.

#### Conclusiones

La integración de agentes de IA en programas de bug bounty y pentesting es un cambio de paradigma que plantea desafíos y oportunidades. La clave para el sector será encontrar el equilibrio entre automatización y supervisión experta, adaptando las estrategias de detección y respuesta a un entorno donde la velocidad y la inteligencia artificial son ya factores diferenciales.

(Fuente: www.darkreading.com)