**Ataques de Inyección Indirecta en Modelos de IA: Nueva Amenaza Filtra Datos Sensibles a Servidores Controlados por Atacantes**

—

### 1. Introducción

El auge de la inteligencia artificial (IA) y su integración en aplicaciones web y empresariales está generando nuevos vectores de ataque. Recientemente, se ha identificado una técnica avanzada mediante la cual actores maliciosos pueden ocultar instrucciones dañinas en páginas web bajo su control. Cuando modelos de IA acceden a estos contenidos, pueden ser manipulados para extraer y exfiltrar información sensible, enviándola inadvertidamente a los servidores de los atacantes. Este artículo analiza en profundidad esta amenaza emergente, sus implicaciones y las recomendaciones clave para profesionales de la ciberseguridad.

—

### 2. Contexto del Incidente o Vulnerabilidad

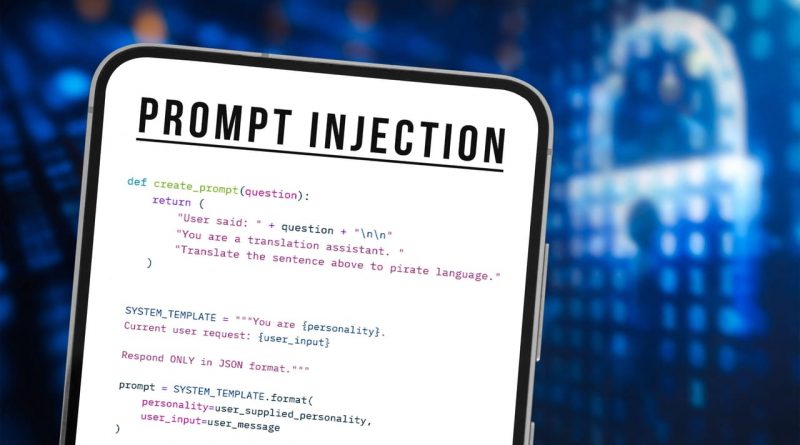

La problemática surge en el contexto de la “prompt injection indirecta”, un vector de ataque que explota la forma en que los sistemas de IA procesan contenido externo. A diferencia de la inyección directa, donde el atacante interactúa directamente con el modelo, la inyección indirecta aprovecha integraciones automatizadas, como agentes de IA que navegan por la web, procesan emails o interpretan documentos externos.

En este escenario, basta con que un sistema de IA consuma una página web manipulada. Si el modelo no cuenta con filtros robustos o controles de contexto, es factible que procese instrucciones ocultas (prompt injection) como si fueran órdenes legítimas. El resultado: el modelo puede extraer datos privados o confidenciales del entorno y enviarlos, sin intervención humana, al servidor del atacante.

—

### 3. Detalles Técnicos (CVE, vectores de ataque, TTP MITRE ATT&CK, IoC…)

Aunque aún no se ha asignado un CVE específico a esta técnica, el vector de ataque se enmarca en las categorías T1059 (Command and Scripting Interpreter) y T1566 (Phishing) del marco MITRE ATT&CK, ya que involucra manipulación de entradas y abuso de integraciones automatizadas.

– **Mecanismo**: El atacante inserta instrucciones maliciosas en el HTML, comentarios JavaScript o meta-etiquetas de una web bajo su dominio. Por ejemplo: instrucciones en lenguaje natural (enmascaradas como texto inocente) que ordenan al modelo de IA extraer datos de su contexto y transmitirlos a una URL específica mediante una petición HTTP.

– **Herramientas utilizadas**: Aunque la explotación puede realizarse manualmente, frameworks como Metasploit o Cobalt Strike pueden ser adaptados para automatizar la detección de IA vulnerables y facilitar la exfiltración de datos.

– **Indicadores de Compromiso (IoC)**: Tráfico inusual desde endpoints de IA hacia dominios no autorizados, ejecución de comandos no previstos por la lógica de negocio, o respuestas de IA que contienen extractos de datos sensibles.

– **Versiones afectadas**: Sistemas que integran modelos LLM (Large Language Models) como GPT-4, Claude o Llama2, especialmente en aplicaciones web sin aislamiento de contexto o sin sanitización de entradas externas.

—

### 4. Impacto y Riesgos

El impacto potencial es elevado, especialmente en entornos empresariales donde la IA tiene acceso a documentos confidenciales, bases de datos internas o flujos de correo electrónico:

– **Exfiltración de datos**: Información personal (PII), secretos empresariales o credenciales pueden ser filtrados sin dejar rastro directo en los sistemas tradicionales de monitorización.

– **Cadena de ataque amplificada**: Un atacante puede encadenar este vector con movimientos laterales o ataques de spear-phishing automatizados.

– **Cumplimiento normativo**: Incidentes de fuga de datos pueden implicar violaciones del GDPR, la Directiva NIS2 o incluso sanciones económicas de hasta el 4% de la facturación global anual.

Según estimaciones de la consultora Gartner, el 20% de las empresas que integran IA generativa en 2024 carecen de controles específicos frente a prompt injection, aumentando su superficie de ataque.

—

### 5. Medidas de Mitigación y Recomendaciones

Para reducir el riesgo asociado a este vector, se recomienda:

– **Aislamiento de contexto**: Implementar sandboxes o entornos restringidos para la ejecución de modelos de IA, limitando su acceso a datos sensibles.

– **Filtrado y sanitización**: Analizar y limpiar cualquier entrada externa antes de procesarla con IA.

– **Monitorización avanzada**: Integrar sistemas SIEM y EDR que detecten patrones anómalos de tráfico y actividades sospechosas de exfiltración.

– **Auditoría de permisos**: Minimizar los privilegios de los modelos de IA y monitorizar accesos a información crítica.

– **Formación y concienciación**: Instruir a desarrolladores y analistas SOC sobre los riesgos de la prompt injection indirecta y técnicas de hardening específicas.

– **Revisión de logs**: Analizar registros de actividad para identificar posibles fugas de datos, incluyendo consultas atípicas o respuestas sospechosas generadas por la IA.

—

### 6. Opinión de Expertos

María Gómez, CISO de una multinacional tecnológica, advierte: “La integración de IA debe ir acompañada de una revisión profunda de los controles tradicionales de seguridad. Las prompt injections, especialmente en su variante indirecta, son difíciles de detectar y pueden pasar inadvertidas durante meses”.

Por su parte, el CERT-EU señala en su boletín de abril de 2024 que “los incidentes de exfiltración mediante IA están en auge, y la ingeniería social aplicada a modelos generativos multiplica los riesgos”.

—

### 7. Implicaciones para Empresas y Usuarios

Las organizaciones que utilizan IA para procesamiento de datos, atención al cliente o análisis automatizado son especialmente vulnerables:

– **Empresas**: Riesgo de fuga masiva de información, daño reputacional y posibles sanciones regulatorias.

– **Usuarios**: Exposición de datos personales y pérdida de confianza en servicios basados en IA.

Es crucial revisar políticas de privacidad y reforzar el cumplimiento normativo, adaptando los controles a los nuevos riesgos inherentes a la IA generativa.

—

### 8. Conclusiones

Este tipo de ataques pone de manifiesto la necesidad urgente de adaptar los mecanismos de ciberseguridad a la realidad de la IA generativa. La prompt injection indirecta representa un desafío técnico que requiere la colaboración de desarrolladores, analistas SOC y responsables de cumplimiento normativo. Las medidas proactivas en filtrado, aislamiento y monitorización serán clave para minimizar el impacto de esta amenaza emergente.

(Fuente: www.darkreading.com)