Agentes de IA como Claude Code desafían los controles de acceso tradicionales en entornos corporativos

1. Introducción

Durante años, los equipos de seguridad han invertido grandes esfuerzos en la construcción de controles de identidad y acceso (IAM) para usuarios humanos y cuentas de servicio. Sin embargo, la irrupción de agentes de Inteligencia Artificial, como Claude Code de Anthropic, ha introducido un nuevo tipo de actor digital que desafía los modelos tradicionales de gobierno de acceso. Este artículo analiza, desde un enfoque técnico, el impacto de estos agentes en la seguridad empresarial, sus vectores de ataque, riesgos, medidas de mitigación y las implicaciones regulatorias y operativas para los profesionales del sector.

2. Contexto del Incidente o Vulnerabilidad

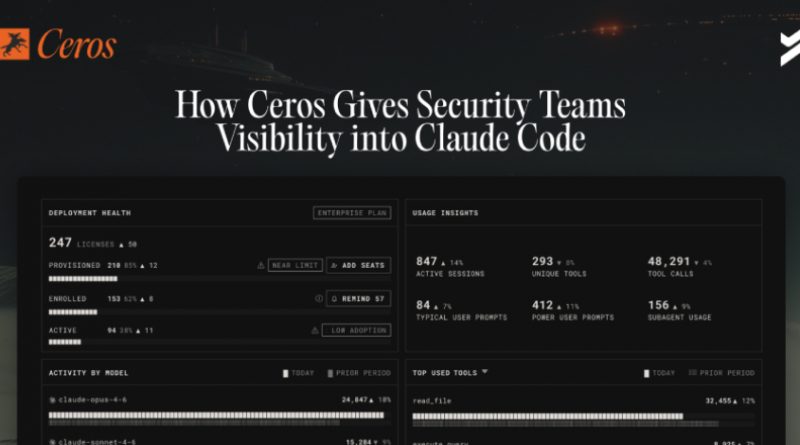

Claude Code es el agente de codificación IA desarrollado por Anthropic, diseñado para asistir a equipos de ingeniería en tareas como análisis de código, automatización de pruebas, lectura de ficheros, ejecución de comandos shell y consumo de APIs externas. Su despliegue masivo en organizaciones ha generado una superficie de ataque inédita, ya que estos agentes operan fuera de los esquemas tradicionales de IAM y, a menudo, con permisos elevados. La falta de visibilidad y control sobre sus acciones plantea retos significativos para equipos SOC, responsables de cumplimiento y administradores.

3. Detalles Técnicos

A diferencia de cuentas de usuario o servicio gestionadas mediante Active Directory, LDAP o Azure AD, los agentes IA como Claude Code funcionan como procesos autónomos que interactúan con sistemas de archivos, shells y redes utilizando credenciales propias, tokens API o claves generadas ad hoc. No existen, por el momento, CVEs específicos asociados a estos agentes, pero su integración se realiza generalmente a través de SDKs y APIs de terceros, lo que introduce vectores de ataque indirectos. Entre las técnicas y tácticas identificadas bajo el marco MITRE ATT&CK destacan:

– T1078 (Valid Accounts): Uso de credenciales internas para acceder a recursos privilegiados.

– T1059 (Command and Scripting Interpreter): Ejecución de comandos shell automatizados.

– T1041 (Exfiltration Over C2 Channel): Potencial extracción de datos a través de llamadas a APIs externas.

– T1136 (Create Account): Creación de identidades efímeras para tareas temporales.

Indicadores de compromiso (IoC) relevantes incluyen logs de acceso no correlacionados con identidades humanas, anomalías en llamadas a APIs y actividad de red inusual hacia endpoints de proveedores de IA.

4. Impacto y Riesgos

El despliegue no gestionado de agentes de IA tiene consecuencias críticas:

– Expansión de la superficie de ataque: Los agentes pueden ejecutar código, acceder a datos sensibles e interactuar con recursos internos y externos.

– Shadow IT: Pueden operar fuera del conocimiento de los equipos de seguridad, dificultando la aplicación de políticas de least privilege.

– Cumplimiento regulatorio: La transferencia y procesamiento de datos mediante estos agentes puede violar GDPR, NIS2 y otras normativas, especialmente si los datos se transmiten fuera del EEE.

– Persistencia y escalabilidad de ataques: Un agente comprometido puede ser utilizado como plataforma de ataque automatizado, facilitando movimientos laterales o exfiltración masiva.

Según estudios recientes, más del 30% de grandes empresas ya utilizan agentes IA en entornos de desarrollo, y el 60% de CISOs reconoce no tener controles específicos para ellos.

5. Medidas de Mitigación y Recomendaciones

Para mitigar estos riesgos, se recomienda:

– Incorporar agentes IA en los sistemas de gestión de identidades (IAM/CIEM), asignando roles y permisos granulados.

– Auditar y monitorizar exhaustivamente la actividad de los agentes: uso de SIEMs, alertas de comportamiento anómalo y correlación de logs.

– Implementar controles de acceso basados en Zero Trust: autenticación continua, segmentación de red y microsegmentación de recursos.

– Revisar y restringir los permisos y scopes de las API keys utilizadas por los agentes.

– Asegurar el cumplimiento normativo mediante Data Loss Prevention (DLP) y herramientas de control de flujo de datos.

– Someter los agentes a pruebas de pentesting y análisis de vulnerabilidades, incluyendo fuzzing y validación de input/output.

6. Opinión de Expertos

Expertos en ciberseguridad, como el equipo de SANS y varios CISOs de empresas Fortune 500, advierten que “los agentes de IA representan la mayor disrupción en los modelos de control de acceso de la última década”. Recomiendan adoptar frameworks como NIST SP 800-53 Rev. 5 para la gestión de riesgos asociados a sistemas autónomos y exigir a proveedores de IA transparencia en el ciclo de vida de las credenciales y el procesamiento de datos.

7. Implicaciones para Empresas y Usuarios

Las empresas deben revisar sus políticas de seguridad para incluir explícitamente la gestión de agentes no humanos. Los usuarios, en particular desarrolladores y DevOps, deben ser formados en los riesgos inherentes a la integración de IA en pipelines de desarrollo y despliegue. El incumplimiento puede derivar en sanciones regulatorias (por ejemplo, multas de hasta el 4% del volumen global bajo GDPR) y daños reputacionales considerables.

8. Conclusiones

La aparición de agentes de IA como Claude Code redefine el paradigma de identidad digital y gestión de acceso en entornos corporativos. Su capacidad para operar fuera del marco IAM tradicional exige un replanteamiento profundo de las estrategias de ciberseguridad. La integración de controles técnicos, políticas robustas y el seguimiento de mejores prácticas internacionales será clave para proteger los activos empresariales en esta nueva era.

(Fuente: feeds.feedburner.com)