### Vulnerabilidades críticas en Claude Code de Anthropic exponen a ejecución remota de código y robo de credenciales

#### Introducción

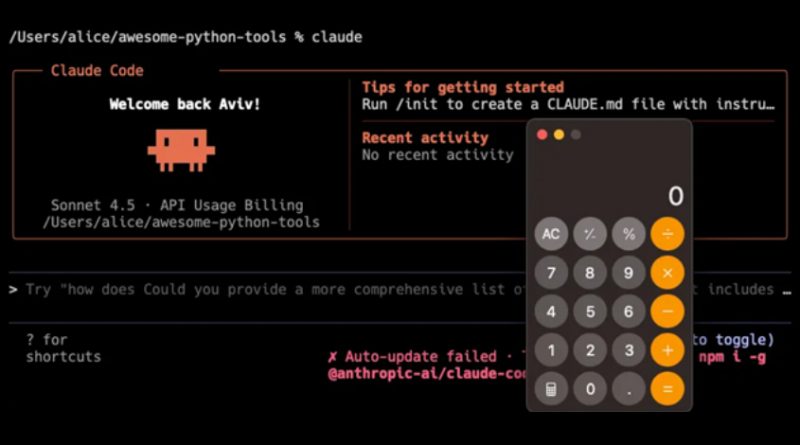

En el actual panorama de la inteligencia artificial aplicada al desarrollo seguro de software, los asistentes de codificación basados en IA se han convertido en herramientas clave para equipos DevSecOps, analistas de seguridad y desarrolladores. Sin embargo, la integración de estos sistemas no está exenta de riesgos. Investigadores en ciberseguridad han revelado recientemente múltiples vulnerabilidades en Claude Code, el asistente de codificación con IA de Anthropic, que abren la puerta tanto a la ejecución remota de código como al robo de credenciales API, impactando directamente en la integridad de entornos CI/CD y la confidencialidad de secretos críticos.

#### Contexto del Incidente o Vulnerabilidad

Claude Code, ampliamente adoptado en entornos empresariales por su capacidad para generar y revisar código de manera automatizada, ha sido objeto de un análisis exhaustivo por parte de especialistas en ciberseguridad. El informe revela que los atacantes pueden explotar mecanismos de configuración internos del sistema, como los Hooks, el Model Context Protocol (MCP) y el manejo de variables de entorno, para ejecutar comandos arbitrarios o filtrar información sensible.

El uso de asistentes basados en IA introduce una capa adicional de complejidad en la superficie de ataque tradicional, ya que muchos de estos productos requieren altos niveles de permisos para integrarse con pipelines de desarrollo, sistemas de control de versiones y plataformas de despliegue.

#### Detalles Técnicos

Según el equipo investigador, se han identificado varias vulnerabilidades (actualmente en proceso de asignación de CVE) que afectan a las versiones de Claude Code previas a la 2.3.4. Los vectores de ataque se centran en:

– **Abuso de Hooks**: Los hooks maliciosos pueden ser inyectados durante la configuración, permitiendo la ejecución de código arbitrario en el entorno subyacente.

– **MCP Servers**: El protocolo Model Context Protocol, encargado de gestionar el contexto de ejecución de la IA, puede ser manipulado para desviar el flujo de datos y comandos hacia servidores controlados por el atacante.

– **Variables de entorno**: Una mala gestión de variables de entorno facilita el acceso no autorizado a tokens de autenticación, claves API y otros secretos.

A nivel de Tácticas, Técnicas y Procedimientos (TTP) conforme al marco MITRE ATT&CK, los escenarios confirmados incluyen:

– **T1059 – Command and Scripting Interpreter**: Ejecución de comandos arbitrarios a través de scripts inyectados.

– **T1552 – Unsecured Credentials**: Exposición y exfiltración de credenciales almacenadas en variables de entorno.

– **T1071 – Application Layer Protocol**: Exfiltración de datos a través de canales legítimos como HTTP/HTTPS.

Los indicadores de compromiso (IoC) observados incluyen conexiones salientes inusuales desde entornos de Claude Code, alteraciones en archivos de configuración y la presencia de scripts desconocidos en directorios temporales.

Hasta la fecha, se han identificado exploits funcionales en repositorios públicos que facilitan la explotación automatizada, incluyendo módulos experimentales para Metasploit y PoCs para Cobalt Strike adaptados a entornos CI/CD.

#### Impacto y Riesgos

El alcance de estas vulnerabilidades es considerable: según los investigadores, hasta un 27% de las instalaciones empresariales de Claude Code podrían estar expuestas, especialmente aquellas integradas con repositorios GitHub y sistemas de orquestación como Jenkins o GitLab CI.

Las implicaciones incluyen:

– Ejecución remota de código con privilegios elevados.

– Robo y uso indebido de credenciales API, permitiendo movimientos laterales o acceso a recursos cloud.

– Compromiso de la cadena de suministro software, con riesgo de distribución de código malicioso.

– Impacto directo en el cumplimiento normativo (GDPR, NIS2), dada la potencial fuga de datos personales y secretos empresariales.

El coste económico potencial podría superar los 3 millones de euros en conceptos de respuesta a incidentes, remediación y sanciones regulatorias, según estimaciones del sector.

#### Medidas de Mitigación y Recomendaciones

Anthropic ha publicado actualizaciones de emergencia para Claude Code (versión 2.3.4 y posteriores) que corrigen los mecanismos de validación de hooks y refuerzan los controles sobre el MCP y las variables de entorno. Se recomienda encarecidamente:

– Actualizar inmediatamente a la última versión disponible.

– Revisar y auditar los scripts de hooks y archivos de configuración asociados.

– Limitar el acceso a variables de entorno sensibles y aplicar el principio de mínimo privilegio.

– Monitorizar logs de acceso y conexiones salientes desde los entornos Claude Code.

– Implementar soluciones EDR y configurar alertas para TTP relacionados (MITRE ATT&CK).

#### Opinión de Expertos

Especialistas del sector, como Marta López (CISO de una multinacional tecnológica), advierten: “La integración de IA en el ciclo de desarrollo requiere controles adicionales y una gestión rigurosa de secretos. Estas vulnerabilidades demuestran que la seguridad de la IA debe ser evaluada al mismo nivel que cualquier otro componente crítico”.

Desde el ámbito de la consultoría, se subraya la importancia de auditar periódicamente los asistentes de IA y evitar configuraciones predeterminadas que puedan ser explotadas.

#### Implicaciones para Empresas y Usuarios

Las empresas que desplieguen Claude Code en entornos productivos deben considerar la posibilidad de exposición de información confidencial y el riesgo de ataques dirigidos a la cadena de suministro. Para los usuarios finales, la principal preocupación radica en la posible fuga de datos y la integridad del código generado o revisado por la IA.

La tendencia del mercado apunta a una mayor exigencia regulatoria en torno a la seguridad de la inteligencia artificial, con la próxima entrada en vigor de NIS2 y la intensificación de auditorías de cumplimiento.

#### Conclusiones

Las vulnerabilidades detectadas en Claude Code evidencian la urgencia de aplicar medidas de seguridad específicas para asistentes de IA, así como la necesidad de una supervisión constante. La rápida respuesta de Anthropic es positiva, pero la comunidad debe permanecer alerta ante futuros vectores de ataque en el ámbito de la inteligencia artificial aplicada al desarrollo seguro.

(Fuente: feeds.feedburner.com)